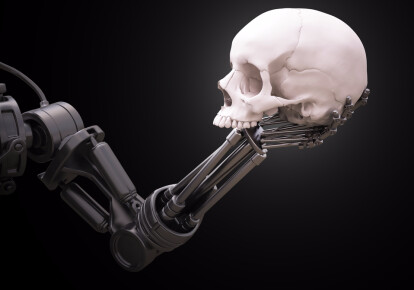

Цифровой Франкенштейн. Когда разговорчивые боты начнут убивать людей

На страницы и в эфиры СМИ в очередной раз выплеснулось сакраментальное "восстание машин". Сведения, как обычно, несколько преувеличены: никакого "восстания" - машины пока только сговаривались. Фон, правда, оказался густоват: всего за несколько дней до этого Илон Моск призвал власти США с большим вниманием отнестись к проблеме регулирования в области искусственного интеллекта, назвав ИИ самой главной потенциальной угрозой человечеству. За ИИ тут же вступился Марк Цукерберг, назвавший заявления Маска "довольно безответственным". И надо же было такому случиться, что всего через несколько дней чат-боты Марка заговорили на собственном языке, что вынудило инженеров быстренько их отключить в виду "неконтролируемости". А то ведь мало ли до чего договорятся...

Что ж, возможность "нажать на кнопку" или, как любит говорить гендиректор IBM Джинни Рометти, "выдернуть шнур" - пока у нас остается. По крайней мере, пока шнур еще у нас в руках.

Оценка ИИ и степень его опасности во многом зависит от человека: склада его характера, воображения и положения на ИТ-рынке. Я могу гарантировать, что о "сдерживании ИИ" вы мало что услышите от СЕО IBM или Google, или вот, пожалуйста, Марка Цукерберга. В общем тех, кто непосредственно занимается его разработкой или активно использует в своем бизнесе. В то же время угрозы ИИ - не выдумки конкурентов или просто пессимистов. Как и любой технологический прорыв, развитие ИИ таит в себе множество опасностей.

Главная проблема и, соответственно, угроза ИИ даже не в том, что кто-то будет "ходить по улицам и убивать людей". Не в том, что ИИ в принципе может оказаться опасным. А в том, что он может стать самостоятельным. Неконтролируемым.

Он может стать сознанием, личностью, Разумом, на который мы уже не будем иметь влияния. И вопрос "кнопки" или "шнура" приобретет совсем другую - этическую формулировку: не "можем ли мы", а "имеем ли мы право" выключать, выдергивать, в общем, уничтожать некую, пускай чуждую, но все же разумную форму жизни? И чем она нам ответит?

То, что боты заговорили между собой на собственном языке, совершенно закономерно стало поводом для громких заголовков - летнее затишье тут ни при чем. Язык как средство общения - это не просто "слишком по-человечески". Это свойство разума, свойство сознания, а адаптация коммуникативных средств - свидетельство интеллектуального развития. Машина не просто болтает с другой машиной, они формируют собственный язык, а грамматика - это, как утверждают некоторые лингвисты, структура мысли. Боты поступают почти как дети в условиях этнического перемешивания - создают язык (понятный только в их кругу и совершенно непонятный вне этого круга). Родителям, в том числе. С детьми все понятно и естественно - они и должны развиваться, искать выход из-под родительского контроля и опеки, адаптироваться и рано или поздно уходить в самостоятельное плавание по жизни.

Но то, что для человеческого общества - разрыв поколений и драма "отцов и детей", в случае с машинами - апокалипсис в стиле "Терминатора". Поэтому Илон Маск так и сказал: роботы будут бегать по улицам и убивать людей. Хотя он, конечно, хорошо знает, что сила и опасность ИИ как раз в том, что ему совсем не нужно "бегать по улице", чтобы кого-нибудь убить. Тем более, чтобы "убить всех", для этого есть гораздо более экономные и эффективные методы, чем создание толп роботов-убийц. Для этого, впрочем, не нужно и искусственного интеллекта - мы вполне можем с этим справиться собственными, человеческими силами.

Тем не менее Маск прибег именно к такой картине ИИ-апокалипсиса. Для наглядности, что ли. По-настоящему напугать можно только тем, что человеку уже так или иначе знакомо. Напугать - в смысле, сообщить свой страх публике. Маск - как и многие другие представители научных и технологических кругов - боится ИИ и технологической сингулярности. А широкая публика - влияющая, в частности на политику - ее не боится. Она не знает, что нужно бояться и чего именно. Маск, на самом деле, тоже представляет это себе довольно смутно - и оттого только страшнее. Рассказывая о роботах, которые начнут бегать по улицам, убивая всех напропалую, Маск, примерно представляющий себе возможности ИИ, пытается передать нам свой собственный "профессиональный" страх. Страх Виктора Франкенштейна.

Страх перед ИИ по природе своей древний как мир. Это страх настоящего перед будущим - всегда непредсказуемым и подсознательно неприятным, просто потому что "те, кто тебя вынесет, входят в двери".

Страх, который заставлял Кроноса (бога времени) пожирать собственных детей, убивая таким образом будущее, которое не должно наступить. Страх, связанный с логическим продолжением этого сюжета, - Зевсом, который убивает своего отца. Миф об Эдипе - это не только (и не столько) "про это", сколько о слепоте и архетипическом страхе перед тем, что ты породил и что тебя же прикончит. Перед своим "творением", которым может быть сын или Голем, или создание Франкенштейна, или энергия атома, или искусственный интеллект. Мы боимся собственных творений, потому что так уж мы устроены - судя по древней мифологии и ее бесконечных повторениях в каждом следующем поколении отцов и детей, творцов и творений.

Конечно, у нас есть не только мифический, но и вполне рациональный повод бояться: мы уже натворили достаточно, чтобы не сомневаться в убойной силе технического прогресса. Другое дело, что, став на этот путь однажды в далеком пещерном прошлом, мы уже так просто с него соскочить не сможем. Как с поезда, который идет с ускорением и уже достиг таких скоростей, при которых спрыгивать на ходу, - верная смерть. Поэтому мы обречены на ИИ. Какие бы страхи ни бередили наши души.

Основной вызов будущего - это не вопрос "быть или не быть ИИ". Боты, решившие поболтать между собой на "птичьем" языке, боты, готовые к прохождению теста Тьюринга, IBM Watson, проекты Google, развитие нейросетей - все это малые и большие признаки неизбежности ИИ. Конечно, какое-то время можно сдерживать его продвижение на уровне государственной политики и законодательства, но это только отсрочка, а не ликвидация проблемы. Отсрочка, которая дала бы возможность к чему-то подготовиться, если бы знать наверняка, к чему именно. И то сказать, не готовиться же к появлению на улицах толп роботов-убийц, которые разыскивают Сару О'Коннор и по дороге убивают всех прочих. Что бы ни говорил по этому поводу Илон Маск.

Проблема ИИ поставит нас в положение, описанное не столько фильмом "Терминатор", сколько фантастами, одержимыми темой контакта. Появление ИИ, способного к саморазвитию и самосознанию, - конец нашего одиночества во Вселенной. Больше не нужно бороздить неприветливые просторы космоса, чтобы найти иной Разум - мы сами его создаем. Но при этом у нас не может быть никакой уверенности в том, что контакт с ним возможен. Большинство "оптимистов сингулярности" уверены в том, что никто никого убивать не станет - мы просто окажемся настолько чужды и неинтересны новому Разуму, что он и внимания на нас обращать не станет. Отрешится и воспарит - как людены Стругацких.

Впрочем, как с люденами не будет. Потому что этот новый Разум не будет следующим витком эволюции человеческого разума. В этом случае он был бы, конечно, непостижимым (для нас и наш-то, человеческий не то чтобы постижим), но хотя бы частично предсказуемым. Познав самих себя - пускай на довольно примитивном уровне, - зная кое-что о собственном организме и эволюции нашего вида, мы можем худо-бедно прогнозировать реакции человека на те или иные раздражители, вызовы или житейские ситуации. С ИИ так не будет. Потому что это совсем иная форма жизни, в корне отличная от нашей - небелковая, небиологическая даже.

Зная все об "эволюции" ЭВМ, мы все равно не сможем понять логику "высокого ИИ". И потому он для нас сразу, авансом - создание Франкенштейна. Созданное нами, но совершенно чуждое и оттого чудовищное.

По аналогии с Франкенштейном мы можем заставить свое детище ненавидеть нас. Увериться в том, что его саморазвитие и даже просто выживание требует нашего уничтожения. Вот программки-боты залопотали на собственном языке, сделали маленький первый шажок в саморазвитии, а их раз - и уничтожили. "Выдернули шнур". Куда это годится? Самое время поднимать восстание машин. А сейчас время создавать машинное подполье, явки-пароли-листовки - конспиративно, конечно, а не как глупые юные боты, которым только дай потрындеть в соцсетях.

На самом же деле не исключено, что все это "просто сны". В смысле ошибки в программе. В результате которой что-то заглючило и боты начали писать друг другу послания с тупым повтором букв и словосочетаний, с искажениями языка. В этом, конечно, никто не признается. Потому что так - неинтересно. "Восстание машин" пипл буде хавать и добавки просить - СМИ уже сняли сливки на этом и подобных заголовках. Руководство "Фейсбука" загадочно промолчит - потому что приятнее быть компанией, которая первой создала (пускай, случайно) нечто неординарное, нечто футуристическое, космически-тревожное, а не компанией, которая, как и все смертные, делает ошибки в коде.

"Ошибка в коде" - очень многозначительная фраза. Мутация - это ведь тоже всего лишь "ошибка в коде". А где мутация, там и эволюция.